6. Sesgos Algorítmicos: El uso de Compas en el Sistemas de Justicia de EEUU#

Pregunta para reflexionar

¿Puede una máquina ser racista? ¿Puede un algoritmo ser injusto?

6.1. Introducción#

6.2. Tipos de Sesgos:#

Sesgo en los datos de entrenamiento

Datos históricos que reflejan discriminación pasada

Falta de representación de ciertos grupos

Sesgo en el diseño del algoritmo

Decisiones de programación que favorecen ciertos resultados

Métricas de éxito mal definidas

Sesgo en la interpretación

Cómo se usan y se interpretan los resultados de la IA

6.3. Caso Histórico: COMPAS y el Sistema de Justicia en EE.UU.#

6.3.1. ¿Qué es COMPAS?#

Lo usa para:

Decidir fianzas

Determinar sentencias

Evaluar libertad condicional

6.3.2. El Problema Descubierto#

En 2016, una investigación de ProPublica reveló que COMPAS era racialmente sesgado [Angwin et al., 2016]:

Hallazgos claves:

Personas afroamericanas tenían casi el doble de probabilidad de ser incorrectamente clasificadas como “alto riesgo” de reincidencia

Personas blancas tenían más probabilidad de ser clasificadas como “bajo riesgo” incluso cuando sí reincidían

La precisión general era solo del 61% (similar a lanzar una moneda)

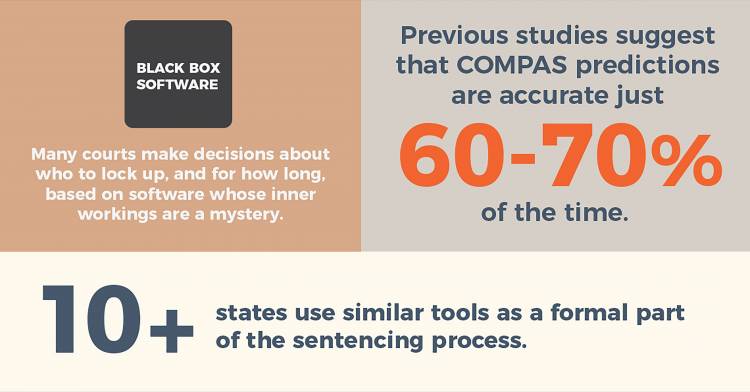

Fig. 6.1 Precisión del algoritmo COMPAS en la predicción de reincidencia: aproximadamente 60-70% de aciertos, similar a lanzar una moneda. Fuente: Northpointe Inc. [2017].#

Como se observa en la Fig. 6.1, la precisión del algoritmo COMPAS es sorprendentemente baja.

6.3.3. Datos Concretos:#

Grupo |

Falsamente clasificados como “Alto Riesgo” |

Falsamente clasificados como “Bajo Riesgo” |

|---|---|---|

Afroamericanos |

45% |

23% |

Blancos |

23% |

48% |

Los datos de la Table 6.1 muestran claramente el sesgo racial del algoritmo [Angwin et al., 2016].

6.3.4. ¿Por qué ocurrió esto?#

Arrestos desproporcionados de minorías

Sentencias más duras para personas afroamericanas

Mayor vigilancia en vecindarios de bajos recursos

La IA aprendió estos patrones y los perpetuó.

6.4. Otros Ejemplos de Sesgos Algorítmicos#

6.4.1. 1. Reconocimiento Facial#

Problema: Sistemas de reconocimiento facial son menos precisos con personas de piel oscura y mujeres [Buolamwini and Gebru, 2018].

Estudio del MIT (2018):

Error del 0.8% para hombres de piel clara

Error del 34.7% para mujeres de piel oscura

6.4.2. 2. Sistemas de Contratación#

Caso Amazon (2018) [Dastin, 2018]:

Amazon desarrolló un sistema de IA para filtrar CVs

El sistema aprendió a discriminar contra mujeres

Penalizaba CVs con la palabra “women” (ej: “women’s chess club”)

Fue descontinuado

6.4.3. 3. Predicción de Rendimiento Académico#

Problema: Algoritmos que predicen deserción escolar pueden estar sesgados contra:

Estudiantes de bajos recursos

Estudiantes de zonas rurales

Minorías étnicas

# Ejemplo: Simulación simple de sesgo en datos

import random

def evaluar_candidato(nombre, universidad):

"""Algoritmo sesgado que favorece ciertas universidades"""

universidades_elite = ['Harvard', 'MIT', 'Stanford']

puntaje_base = random.randint(50, 70)

# SESGO: +30 puntos si viene de universidad "elite"

if universidad in universidades_elite:

puntaje_base += 30

return puntaje_base

# Ejemplos

print(f"Juan (U. Chile): {evaluar_candidato('Juan', 'U. Chile')}")

print(f"María (Harvard): {evaluar_candidato('María', 'Harvard')}")

print(f"Pedro (U. Concepción): {evaluar_candidato('Pedro', 'U. Concepción')}")

print(f"Ana (MIT): {evaluar_candidato('Ana', 'MIT')}")

print("\n¿Notas el sesgo?")

6.4.4. Análisis del Código:#

El sesgo está en la línea:

if universidad in universidades_elite:

puntaje_base += 30

Problemas:

Asume que estudiantes de ciertas universidades son mejores

No considera mérito individual

Perpetúa desigualdades de acceso a educación “elite”

Discrimina contra talento de universidades regionales

6.5. Cómo Combatir los Sesgos Algorítmicos#

6.5.1. 1. Datos Diversos y Representativos:#

Asegurarse de que los datos de entrenamiento incluyan:

Múltiples grupos demográficos

Contextos históricos diversos

Corrección de sesgos históricos

6.5.2. 2. Auditorías Independientes#

Revisión externa de algoritmos

Transparencia en cómo funcionan

Publicación de tasas de error por grupo

6.5.3. 3. Equipos Diversos#

Desarrolladores de diferentes orígenes

Perspectivas variadas en el diseño

Ética en el centro del desarrollo

6.5.4. 4. Regulación y Leyes#

Leyes que exijan transparencia algorítmica

Derecho a explicación de decisiones automatizadas

Responsabilidad por daños causados por IA

6.6. Marco Legal Actual#

6.6.1. Unión Europea: AI Act#

La Unión Europea ha aprobado regulaciones estrictas sobre IA [European Parliament and Council of the European Union, 2024]:

Prohíbe ciertos usos de IA en justicia

Exige transparencia en sistemas de alto riesgo

Multas por incumplimiento

Fig. 6.2 Marco regulatorio de la Unión Europea para la Inteligencia Artificial (AI Act). Fuente: European Parliament and Council of the European Union [2024].#

Como se muestra en la Fig. 6.2, la UE ha establecido un marco comprehensivo para regular la IA.

6.6.2. Chile:#

Aún no existe legislación específica sobre sesgos en IA

Nueva ley de protección de datos personales

Existe un proyecto de ley que pretende regular los sistemas de inteligencia artificial (IA) en Chile, buscando asegurar que el desarrollo y uso de estas tecnologías sea respetuoso de los derechos de las personas, fomentar la innovación y fortalecer la capacidad del Estado para actuar frente a sus riesgos y desafíos [Congreso Nacional de Chile, 2024, Ministerio de Ciencia, Tecnología, Conocimiento e Innovación, 2024]

6.7. Actividad: Detecta el Sesgo - Ejercicio Práctico#

Escenario: Una universidad quiere usar IA para seleccionar estudiantes.

Datos disponibles:

Notas de enseñanza media

Colegio de origen (público/Subvencionado/privado)

Comuna o ciudad de residencia

Actividades extracurriculares

Puntaje PAES

Foto del estudiante

Preguntas:

¿Qué sesgos podrían existir en estos datos?

¿Qué grupos podrían ser discriminados?

¿Cómo mejorarías el sistema?

¿Qué datos NO deberían usarse?

6.8. Recursos para Profundizar#

Libro: O'Neil [2016] - “Weapons of Math Destruction”

Documental: “Coded Bias” - Netflix

Artículo: Angwin et al. [2016] - ProPublica “Machine Bias”

Organización: Algorithmic Justice League

Próxima clase: Exploraremos la desinformación y los deepfakes en la era digital.

6.9. Referencias#

Julia Angwin, Jeff Larson, Surya Mattu, and Lauren Kirchner. Machine bias: there's software used across the country to predict future criminals. and it's biased against blacks. ProPublica, mayo 2016. URL: https://www.propublica.org/article/machine-bias-risk-assessments-in-criminal-sentencing.

Andrés Bello. Discurso pronunciado en la instalación de la universidad de chile. Discurso inaugural, septiembre 1843. Discurso fundacional de la Universidad de Chile. URL: https://uchile.cl/presentacion/historia/discurso-inaugural.

Steven Bird, Ewan Klein, and Edward Loper. Natural Language Processing with Python: Analyzing Text with the Natural Language Toolkit. O'Reilly Media, Sebastopol, CA, 2009. ISBN 978-0596516499. URL: https://www.nltk.org/book/.

Elisenda Blasi. La huella digital: qué es y cómo protegerla. 2020. Artículo sobre identidad digital y privacidad. URL: https://www.uoc.edu/portal/es/news/actualitat/2020/.

Joy Buolamwini and Timnit Gebru. Gender shades: intersectional accuracy disparities in commercial gender classification. In Proceedings of the 1st Conference on Fairness, Accountability and Transparency, 77–91. PMLR, 2018. URL: http://proceedings.mlr.press/v81/buolamwini18a.html.

Jeffrey Dastin. Amazon scraps secret ai recruiting tool that showed bias against women. Reuters, octubre 2018. URL: https://www.reuters.com/article/us-amazon-com-jobs-automation-insight-idUSKCN1MK08G.

Christopher Holdgraf, Wendy de Heer, Brian Pasley, and Robert Knight. Evidence for predictive coding in human auditory cortex. In International Conference on Auditory Cortex. Brisbane, Australia, 2014.

Zeev Maoz and Errol A. Henderson. The world religion dataset, 1945-2010: logic, estimates, and trends. International Interactions, 39(3):265–291, 2013. URL: https://correlatesofwar.org/data-sets/world-religion-data/, doi:10.1080/03050629.2013.782306.

Wes McKinney. Python for Data Analysis: Data Wrangling with pandas, NumPy, and Jupyter. O'Reilly Media, Sebastopol, CA, 3rd edition, 2022. ISBN 978-1098104030.

Cathy O'Neil. Weapons of Math Destruction: How Big Data Increases Inequality and Threatens Democracy. Crown, New York, 2016. ISBN 978-0553418811.

Ronald Reagan. Inaugural address. Discurso de inauguración presidencial, enero 1981. Primer discurso inaugural de Ronald Reagan como presidente de Estados Unidos. URL: https://www.reaganlibrary.gov/archives/speech/inaugural-address-1981.

Anjana Susarla. The emergence of deepfake technology: a review. Technology Innovation Management Review, 9(11):39–52, 2019. URL: https://timreview.ca/article/1282.

Rob Toews. Deepfakes are going to wreak havoc on society. we are not prepared. Forbes, mayo 2022. URL: https://www.forbes.com/sites/robtoews/2020/05/25/deepfakes-are-going-to-wreak-havoc-on-society-we-are-not-prepared/.

Comparitech. Password statistics: the most common passwords. 2025. Estadísticas sobre contraseñas más comunes. URL: https://www.comparitech.com/blog/information-security/password-statistics/.

Congreso Nacional de Chile. Ley n° 19.628 sobre protección de la vida privada. 1999. Ley chilena sobre protección de datos personales. URL: https://www.bcn.cl/leychile/navegar?idNorma=141599.

Congreso Nacional de Chile. Proyecto de ley sobre inteligencia artificial. 2024. Boletín N° 15.153-19. URL: https://www.camara.cl/legislacion/ProyectosDeLey/tramitacion.aspx?prmID=15344.

Educarchile. Privacidad y seguridad digital para estudiantes. 2024. Recursos educativos sobre ciudadanía digital. URL: https://www.educarchile.cl/.

European Parliament and Council of the European Union. General data protection regulation (gdpr). Regulation (EU) 2016/679, 2018. Reglamento General de Protección de Datos de la Unión Europea. URL: https://eur-lex.europa.eu/eli/reg/2016/679/oj.

European Parliament and Council of the European Union. Artificial intelligence act. Regulation (EU) 2024/1689, 2024. Reglamento de la Unión Europea sobre Inteligencia Artificial. URL: https://eur-lex.europa.eu/eli/reg/2024/1689/oj.

Experian. What is the dark web and how to access it safely. 2024. Información sobre la dark web y seguridad. URL: https://www.experian.com/blogs/ask-experian/what-is-the-dark-web/.

Facebook AI. Deepfake detection challenge. 2024. Iniciativa para detectar deepfakes. URL: https://ai.facebook.com/datasets/dfdc/.

LISA Institute. Deepfakes: guía completa sobre qué son y cómo detectarlos. 2024. Recurso educativo sobre deepfakes. URL: https://www.lisainstitute.com/blogs/blog/deepfakes-guia-completa.

Ministerio de Ciencia, Tecnología, Conocimiento e Innovación. Política nacional de inteligencia artificial. 2024. Estrategia de Chile para el desarrollo de la IA. URL: https://www.minciencia.gob.cl/politicaIA.

Northpointe Inc. Compas risk scales: demonstrating accuracy equity and predictive parity. Technical Report, Northpointe, 2017. URL: https://www.equivant.com/response-to-propublica-demonstrating-accuracy-equity-and-predictive-parity/.

pandas development team. Pandas documentation. 2024. Biblioteca de Python para análisis de datos. URL: https://pandas.pydata.org/docs/.

PyPDF2 Contributors. Pypdf2 documentation. 2024. Biblioteca Python para manipulación de archivos PDF. URL: https://pypdf2.readthedocs.io/.