7. Desinformación y Deepfakes en la Era Digital#

Como advierte Toews [2022]:

Hoy estamos en un punto de inflexión. En los próximos meses y años, los deepfakes amenazan con pasar de ser una rareza de Internet a una fuerza política y social ampliamente destructiva. La sociedad necesita actuar ahora para prepararse.

7.1. Introducción#

from IPython.display import YouTubeVideo

YouTubeVideo('ACVglWBYhQA', width=800, height=450)

7.1.1. Tipos de información falsa:#

Desinformación (Disinformation)

Información falsa creada intencionalmente para engañar.

Ejemplo: Noticias falsas sobre resultados electorales.

Información errónea (Misinformation)

Información falsa compartida sin intención de engañar.

Ejemplo: Compartir un rumor que creíste verdadero.

Malinformación (Malinformation)

Información verdadera pero compartida para causar daño.

Ejemplo: Filtración de datos personales.

7.2. DeepFakes#

¿Qué es una Deepfake?

7.2.1. Tecnología detrás de los Deepfakes:#

Redes Neuronales Generativas Adversariales (GANs):

Una IA crea contenido falso

Otra IA intenta detectar si es falso

Compiten hasta que el falso es indistinguible del real

7.2.2. Ejemplo visual del proceso:#

Pseudocódigo simplificado de cómo funciona un deepfake:

def crear_deepfake(video_original, rostro_objetivo):

# 1. Extraer rostro del video original

rostros = extraer_rostros(video_original)

# 2. Mapear rostro objetivo sobre cada frame

for frame in rostros:

frame_falso = reemplazar_rostro(frame, rostro_objetivo)

ajustar_iluminacion(frame_falso)

ajustar_expresiones(frame_falso)

# 3. Sincronizar audio con movimientos labiales

sincronizar_labios(frames_falsos, audio_original)

return video_deepfake

7.3. Casos Históricos Famosos#

7.3.1. 1. Deepfake de Obama (2018)#

Objetivo: Educar al público sobre deepfakes.

Resultado: Millones de visualizaciones y conciencia sobre el problema.

from IPython.display import YouTubeVideo

YouTubeVideo('cQ54GDm1eL0', width=800, height=450)

7.3.2. 2. Deepfake de Mark Zuckerberg (2019)#

Contexto: Instagram (propiedad de Facebook) permitió que un deepfake de su propio CEO permaneciera en la plataforma [Susarla, 2019].

Lo que decía el falso Zuckerberg:

“Imagina esto por un segundo: Un hombre, con control total de miles de millones de datos robados, todos sus secretos, sus vidas, sus futuros… Quien controla los datos, controla el futuro.”

La ironía:

Facebook/Instagram NO eliminó el video

Argumentaron que su política no requería borrar deepfakes

Esto generó enorme controversia

Temas que desató:

🔐 Privacidad de datos - ¿Cuánto sabe Facebook de nosotros?

⚖️ Responsabilidad de plataformas - ¿Deben eliminar deepfakes?

📜 Regulación - ¿Necesitamos leyes específicas?

Lección clave: Las grandes tecnológicas también son vulnerables a su propia tecnología.

7.3.3. 3. Guerra en Ucrania (2022)#

Uno de los primeros conflictos con abundante desinformación por IA [Facebook AI, 2024]:

Deepfake de Zelensky “rindiéndose” (falso)

Videos viejos presentados como actuales

Imágenes generadas por IA de supuestas atrocidades

7.4. Tipos de Deepfakes#

7.4.1. 1. Video#

Reemplazo de rostro completo.

Manipulación de expresiones.

Ejemplo: Poner tu cara en una película.

7.4.2. 2. Audio (Voice Cloning)#

Clonar voz de cualquier persona.

Solo necesitan ~3-10 segundos de audio original.

Aplicaciones: estafas telefónicas, suplantación.

7.4.3. 3. Texto#

ChatGPT puede imitar estilos de escritura.

Generar artículos “de periódicos” falsos.

Crear perfiles falsos en redes sociales.

7.4.4. 4. Cheapfakes (manipulación simple)#

No usan IA avanzada.

Edición básica pero efectiva.

Ejemplo: Videos en cámara lenta para hacer que alguien parezca ebrio.

Fig. 7.1 Tasas de error en sistemas de reconocimiento facial según género y tono de piel: 0.8% para hombres de piel clara vs 34.7% para mujeres de piel oscura. Fuente: MIT Media Lab (2018).#

Como se observa en la Fig. 7.1, los sistemas de reconocimiento facial muestran sesgos significativos según género y tono de piel.

Según LISA Institute [2024]:

El impacto más negativo que pueden causar los Deepfakes es generar en la sociedad una ausencia absoluta de confianza, lo que termine ocasionando un gran desinterés a la hora de diferenciar entre los archivos verdaderos y los Deepfakes. Cuando esta confianza es erosionada, se facilita mucho el hecho de generar dudas e inculcar ideas erróneas, dificultando el pensamiento crítico.

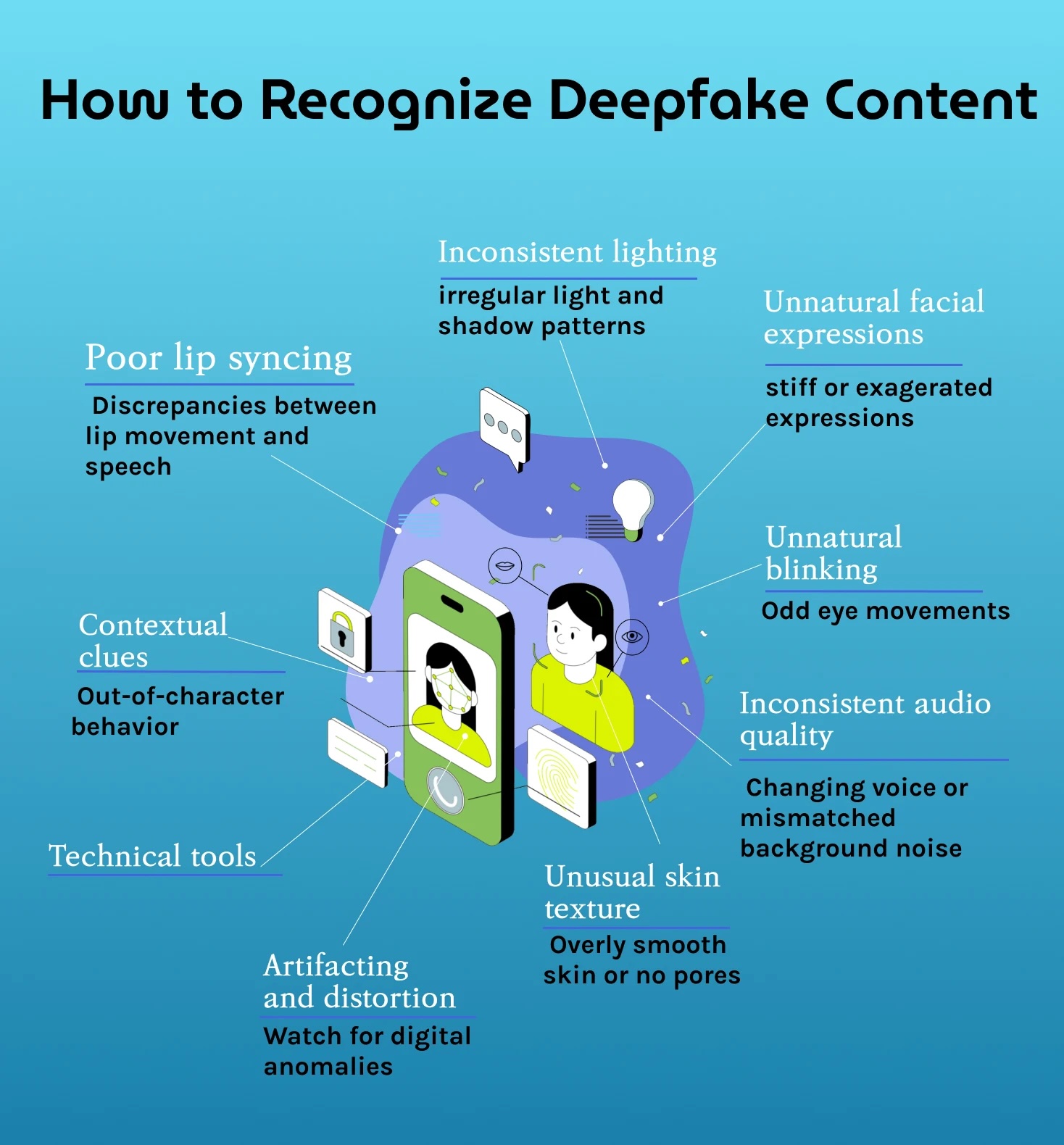

7.5. Cómo Detectar Deepfakes#

7.5.1. Señales visuales en videos: Checklist de detección#

✓ Parpadeo extraño o inexistente

✓ Movimientos labiales no sincronizados con el audio

✓ Cambios de iluminación inconsistentes

✓ Bordes borrosos alrededor del rostro

✓ Artefactos digitales en el cabello

✓ Sombras que no corresponden

✓ Calidad de video inconsistente

7.6. Referencias#

Julia Angwin, Jeff Larson, Surya Mattu, and Lauren Kirchner. Machine bias: there's software used across the country to predict future criminals. and it's biased against blacks. ProPublica, mayo 2016. URL: https://www.propublica.org/article/machine-bias-risk-assessments-in-criminal-sentencing.

Andrés Bello. Discurso pronunciado en la instalación de la universidad de chile. Discurso inaugural, septiembre 1843. Discurso fundacional de la Universidad de Chile. URL: https://uchile.cl/presentacion/historia/discurso-inaugural.

Steven Bird, Ewan Klein, and Edward Loper. Natural Language Processing with Python: Analyzing Text with the Natural Language Toolkit. O'Reilly Media, Sebastopol, CA, 2009. ISBN 978-0596516499. URL: https://www.nltk.org/book/.

Elisenda Blasi. La huella digital: qué es y cómo protegerla. 2020. Artículo sobre identidad digital y privacidad. URL: https://www.uoc.edu/portal/es/news/actualitat/2020/.

Joy Buolamwini and Timnit Gebru. Gender shades: intersectional accuracy disparities in commercial gender classification. In Proceedings of the 1st Conference on Fairness, Accountability and Transparency, 77–91. PMLR, 2018. URL: http://proceedings.mlr.press/v81/buolamwini18a.html.

Jeffrey Dastin. Amazon scraps secret ai recruiting tool that showed bias against women. Reuters, octubre 2018. URL: https://www.reuters.com/article/us-amazon-com-jobs-automation-insight-idUSKCN1MK08G.

Christopher Holdgraf, Wendy de Heer, Brian Pasley, and Robert Knight. Evidence for predictive coding in human auditory cortex. In International Conference on Auditory Cortex. Brisbane, Australia, 2014.

Zeev Maoz and Errol A. Henderson. The world religion dataset, 1945-2010: logic, estimates, and trends. International Interactions, 39(3):265–291, 2013. URL: https://correlatesofwar.org/data-sets/world-religion-data/, doi:10.1080/03050629.2013.782306.

Wes McKinney. Python for Data Analysis: Data Wrangling with pandas, NumPy, and Jupyter. O'Reilly Media, Sebastopol, CA, 3rd edition, 2022. ISBN 978-1098104030.

Cathy O'Neil. Weapons of Math Destruction: How Big Data Increases Inequality and Threatens Democracy. Crown, New York, 2016. ISBN 978-0553418811.

Ronald Reagan. Inaugural address. Discurso de inauguración presidencial, enero 1981. Primer discurso inaugural de Ronald Reagan como presidente de Estados Unidos. URL: https://www.reaganlibrary.gov/archives/speech/inaugural-address-1981.

Anjana Susarla. The emergence of deepfake technology: a review. Technology Innovation Management Review, 9(11):39–52, 2019. URL: https://timreview.ca/article/1282.

Rob Toews. Deepfakes are going to wreak havoc on society. we are not prepared. Forbes, mayo 2022. URL: https://www.forbes.com/sites/robtoews/2020/05/25/deepfakes-are-going-to-wreak-havoc-on-society-we-are-not-prepared/.

Comparitech. Password statistics: the most common passwords. 2025. Estadísticas sobre contraseñas más comunes. URL: https://www.comparitech.com/blog/information-security/password-statistics/.

Congreso Nacional de Chile. Ley n° 19.628 sobre protección de la vida privada. 1999. Ley chilena sobre protección de datos personales. URL: https://www.bcn.cl/leychile/navegar?idNorma=141599.

Congreso Nacional de Chile. Proyecto de ley sobre inteligencia artificial. 2024. Boletín N° 15.153-19. URL: https://www.camara.cl/legislacion/ProyectosDeLey/tramitacion.aspx?prmID=15344.

Educarchile. Privacidad y seguridad digital para estudiantes. 2024. Recursos educativos sobre ciudadanía digital. URL: https://www.educarchile.cl/.

European Parliament and Council of the European Union. General data protection regulation (gdpr). Regulation (EU) 2016/679, 2018. Reglamento General de Protección de Datos de la Unión Europea. URL: https://eur-lex.europa.eu/eli/reg/2016/679/oj.

European Parliament and Council of the European Union. Artificial intelligence act. Regulation (EU) 2024/1689, 2024. Reglamento de la Unión Europea sobre Inteligencia Artificial. URL: https://eur-lex.europa.eu/eli/reg/2024/1689/oj.

Experian. What is the dark web and how to access it safely. 2024. Información sobre la dark web y seguridad. URL: https://www.experian.com/blogs/ask-experian/what-is-the-dark-web/.

Facebook AI. Deepfake detection challenge. 2024. Iniciativa para detectar deepfakes. URL: https://ai.facebook.com/datasets/dfdc/.

LISA Institute. Deepfakes: guía completa sobre qué son y cómo detectarlos. 2024. Recurso educativo sobre deepfakes. URL: https://www.lisainstitute.com/blogs/blog/deepfakes-guia-completa.

Ministerio de Ciencia, Tecnología, Conocimiento e Innovación. Política nacional de inteligencia artificial. 2024. Estrategia de Chile para el desarrollo de la IA. URL: https://www.minciencia.gob.cl/politicaIA.

Northpointe Inc. Compas risk scales: demonstrating accuracy equity and predictive parity. Technical Report, Northpointe, 2017. URL: https://www.equivant.com/response-to-propublica-demonstrating-accuracy-equity-and-predictive-parity/.

pandas development team. Pandas documentation. 2024. Biblioteca de Python para análisis de datos. URL: https://pandas.pydata.org/docs/.

PyPDF2 Contributors. Pypdf2 documentation. 2024. Biblioteca Python para manipulación de archivos PDF. URL: https://pypdf2.readthedocs.io/.